La fusione

Le barriere tra mondo fisico e digitale stanno per crollare e ciò avverrà - letteralmente - davanti ai nostri occhi.

Ha reso il mondo digitale parte integrante della nostra vita quotidiana. Ha modificato la percezione che abbiamo di noi stessi. E ha perfino dato avvio alla fusione tra uomo e macchina. Lo smartphone ha avuto un impatto colossale non solo sulla società, ma anche direttamente sul “funzionamento” dell’essere umano. Eppure il suo ormai decennale avvento costituisce solo la prima tappa di un lungo tragitto che porterà la tecnologia a essere sempre più incorporata in noi, rendendo gradualmente indistinguibili i due livelli (fisico e digitale) sui quali la nostra vita ancora oggi scorre. A differenza di quanto si poteva immaginare solo qualche anno fa, però, la seconda tappa di questo lungo percorso non è costituito dagli smartwatch, che rappresentano semmai un mediatore tra noi e lo smartphone.

In fondo, perché il processo di avvicinamento della tecnologia al corpo umano deve passare da un dispositivo che indosso al polso quando posso averlo direttamente davanti agli occhi? Ecco quale sarà la prossima tappa: gli smartglass, visori digitali in grado di fondere il mondo fisico e quello digitale. Da questo punto di vista, la decisione di Alphabet di rilanciare a livello professionale i Google Glass (in passato uno dei suoi flop più clamorosi) ha dimostrato una cosa: non era l’idea a essere sbagliata, ma i tempi a essere troppo precoci. Svelato sotto forma di prototipo già nel 2012, il visore digitale fallì non solo per l’elevato costo (1.500 dollari) e per il fatto che mettesse a disagio sia chi li indossava sia chi si trovava nei paraggi, ma soprattutto per la mancanza di una killer app che rendesse davvero evidente il vantaggio di questi occhiali intelligenti rispetto ai normali smartphone.

In verità, già allora l’azienda di Mountain View aveva le idee chiare su quale fosse l’applicazione fondamentale per i suoi visori: la realtà aumentata, che permette di sovrapporre il digitale all’ambiente che ci circonda. Una tecnologia diventata davvero popolare solo con il lancio dei Pokémon Go nell’estate 2016, ma sulla quale tutte le più importanti aziende tecnologiche stanno da tempo lavorando: da Apple a Microsoft (una delle prime società a credere in questo tipo di progetto con i suoi Hololens), fino a Samsung.

L’ultimo ad aggiungersi alla grande corsa è stato proprio Facebook. Nel corso dell’evento Connect del 16 settembre 2020, Mark Zuckerberg ha infatti annunciato il lancio, previsto per l’anno prossimo, di un dispositivo che rappresenterà “il prossimo passo sulla strada degli occhiali in realtà aumentata”. Non ancora un vero e proprio visore in AR (augmented reality) in grado di fondere completamente il mondo fisico e quello digitale – su cui comunque Facebook sta già lavorando – ma degli smart glasses marchiati Ray-Ban (dell’italiana Luxottica) dotati di qualche funzionalità digitale.

Nonostante tutti sembrino essere certi che gli occhiali in realtà aumentata rappresentano la prossima grande evoluzione tecnologica (che porterà fotocamera, applicazioni, notifiche dei social network e quant’altro direttamente davanti ai nostri occhi), i colossi digitali stanno infatti seguendo due strade molto diverse per raggiungere questo traguardo.

Da una parte c’è chi, come Microsoft o Google, ha preferito mettere in commercio ingombranti visori AR completi di quasi tutte le funzionalità, ma utilizzabili solo a scopo professionale (almeno finché non sarà possibile ridurne le dimensioni e renderli così adatti all’uso quotidiano). Dall’altra parte della barricata si schiera invece chi – come Facebook e Amazon – ritiene che sia meglio lanciare sul mercato occhiali smart all’apparenza normali, e quindi utilizzabili tutti i giorni, ma dotati di funzionalità limitate (scattare foto, comunicare con l’assistente digitale e poco più), con l’obiettivo di abituare i consumatori a questi nuovi prodotti e di aggiungere le funzionalità più evolute mano a mano che la tecnologia lo consentirà.

Con il passare del tempo, questi dispositivi diventeranno però sempre più simili tra loro: le notifiche dei social network e delle mail appariranno davanti ai vostri occhi; interagiremo con ciò che compare sui visori (messaggi, ordinazioni, ricerche sul web, eccetera) non più digitando, ma dialogando con il nostro assistente virtuale; le indicazioni stradali saranno direttamente integrate al mondo fisico (come le informazioni su monumenti e altro), mentre video e fotografie diventeranno ancora più pervasivi (come anticipato – nonostante il loro scarso successo – anche dagli Spectacles di Snapchat), creando un flusso non stop di informazioni in presa diretta. Per gestire questa mole di contenuti e notifiche useremo anche le mani: un gesto rapido verso destra potrebbe indicare di cancellare una mail o ignorare una notifica; muovere la mano in avanti metterà in evidenza il messaggio appena arrivato e, insomma, vi ricordate Minority Report?

Manca ancora del tempo affinché questa “realtà artificiale” – come l’ha definita il co-fondatore di Oculus, Brendan Iribe – si diffonda davvero. È però evidente come i visori in realtà aumentata rappresentino un passaggio cruciale della fusione tra mondo fisico e digitale grazie alla loro capacità di rendere questa unione frictionless, priva cioè di quella frizione tra i due ambienti (la necessità di inquadrare il mondo fisico con un dispositivo per sovrapporre a esso gli elementi digitali) che contraddistingue le applicazioni AR degli smartphone. Ancora più importante è il fatto che, indossando questi visori come fossero occhiali, la nostra condizione di base sarà di essere connessi alla rete e al fiume di attività che possiamo gestire con questi headset; per staccare dovremo decidere di levarceli dagli occhi.

Questi visori rappresentano quindi un passo avanti cruciale per la fusione tra mondo digitale e mondo fisico e tra tecnologia e corpo umano, ma la prospettiva finale – per quanto possa sembrare assurdo – è un’altra: trasformare gli esseri umani in veri e propri cyborg. Non pensate a Robocop, ma al significato letterale di cyborg: un organismo vivente sul quale sono stati innestati degli organi sintetici. A differenza delle protesi artificiali già note (che hanno lo scopo di rimpiazzare arti perduti o gravemente danneggiati), le nuove protesi digitali puntano invece ad aumentare le capacità sensoriali degli esseri umani. Una prospettiva ancora lontana, ma per raggiungere la quale si lavora alacremente nei laboratori di ricerca accademica e dei colossi del tech. Un primo prototipo è stato recentemente presentato dai ricercatori dell’Università della California San Diego ed entra a pieno titolo nel percorso che dovrebbe portare – in un futuro oggi ancora lontano – alla produzione delle cosiddette smart lens: lenti a contatto altamente tecnologiche che sostituiranno i visori in realtà aumentata; riducendo ulteriormente la frizione tra mondo digitale e mondo fisico.

Il prototipo mostrato dai ricercatori riguarda infatti una lente a contatto in grado di mettere a fuoco automaticamente ciò che stiamo guardando a seconda della distanza a cui si trova dal nostro occhio, arrivando addirittura a zoomare per inquadrare gli oggetti più lontani. Per comandare le funzioni di questa lente non dovremo però schiacciare dei tasti su un dispositivo che la controlla, ma sfrutteremo direttamente i segnali elettrici generati dai movimenti dell’occhio, utilizzando a questo scopo degli elettrodi posti sulla pelle.

Gli ostacoli tecnologici per rendere tutto ciò realtà non sono però da poco e hanno già portato allo stop di un progetto simile da parte di Google. Sfogliando i nomi delle organizzazioni e delle aziende che stanno lavorando su queste tecnologie, si capisce come la faccenda sia comunque da prendere sul serio: la DARPA sarebbe pronta a investire su una smart lens progettata nei laboratori dell’istituto francese IMT Atlantique, mentre Samsung (uno dei primi colossi a brevettare le lenti a contatto hi-tech, già nel 2014) ha depositato nel luglio 2019 un nuovo brevetto riguardante smart lens in grado di registrare video, scattare fotografie e controllare dispositivi come gli smartphone attraverso gli occhi.

Si tratta degli inevitabili passaggi intermedi che condurranno un giorno alla next big thing: le lenti a contatto in realtà aumentata in grado di superare i limiti dei visori AR, trasformandoci in esseri umani perfettamente integrabili nel mondo digitale. La startup Mojo Vision, che ha già raccolto finanziamenti per oltre 50 milioni di dollari da svariati colossi, tra cui Google e LG Electronics, sta lavorando esplicitamente a questo scopo. Quella delle smart lens è una prospettiva che dista ancora parecchio, ma quando sarà realtà modificherà ulteriormente la nostra condizione di base: a quel punto, ci sconnetteremo solo per andare a dormire; il resto del nostro tempo sarà invece sempre immerso nella rete.

Il percorso tracciato dall’innovazione tecnologica è evidente: dallo smartphone, una sorta di protesi digitale che è però staccata dal nostro corpo e che ci costringe ad alternare l’immersione nel mondo digitale al tempo trascorso nel mondo fisico, ai visori in AR, che permettono di avere sotto controllo il mondo fisico e digitale contemporaneamente, fino alle lenti a contatto smart, che aumenteranno i nostri sensi e attraverso le quali saremo sempre connessi alla rete. La tecnologia si miniaturizza e si avvicina sempre di più al corpo umano, fino a fondersi in esso.

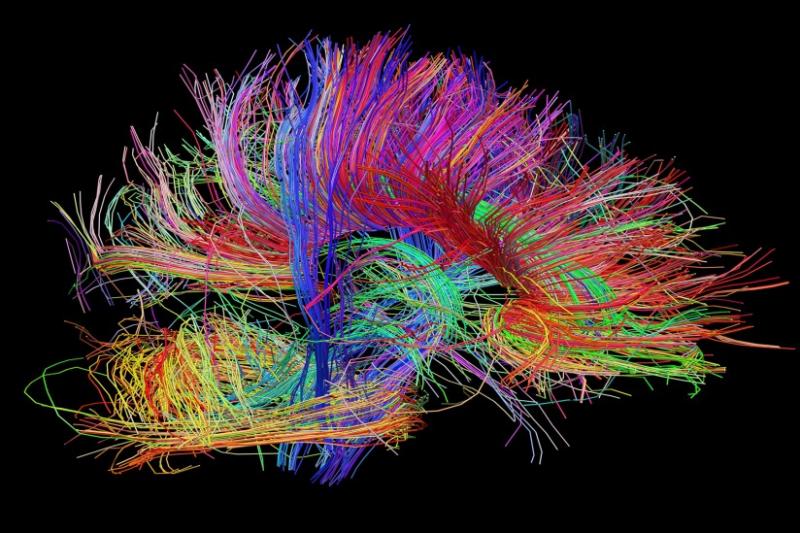

Da questo punto di vista, nessun obiettivo è più ambizioso della produzione di un’interfaccia cervello-macchina che colleghi la mente umana direttamente ai computer. Elon Musk è il fondatore della più nota startup del settore: Neuralink, la società dedita alla creazione di un’interfaccia umano-macchina che, attraverso un “laccio neurale”, aumenti le capacità del cervello umano. Per quanto sembri un progetto fantascientifico, alcune versioni di queste interfacce macchina-computer esistono in realtà da tempo e vengono usate a scopi medici: era il 2006 quando un primo paziente – Matthew Nagle, affetto da una paralisi del midollo spinale – si sottopose a un impianto cerebrale sviluppato dalla Brown University che gli permise di giocare a Pong usando la mente. Da allora, numerose persone paralizzate hanno utilizzato impianti cerebrali per muovere arti robotici o comunicare via tablet con i propri cari.

“Stiamo lavorando sulle spalle dei giganti che ci hanno preceduto”, ha infatti affermato il presidente di Neuralink Max Hodak. L’obiettivo della startup fondata da Musk va però oltre le sole applicazioni mediche. A cos’altro può servire uno strumento di questo tipo? Un esempio può chiarire il quadro: se oggi non ci ricordiamo il regista di un film, digitiamo il nome del film su Google e da lì risaliamo al regista. Immaginate di poter fare la stessa cosa usando direttamente il cervello, richiamando quindi i dati di cui abbiamo bisogno come oggi richiamiamo alla mente un ricordo nitido. Allo stesso modo, potremo prendere appunti, impostare promemoria, ottenere le indicazioni stradali e molto altro ancora usando direttamente il cervello, che a quel punto – connesso attraverso un’interfaccia cervello-macchina – diventerà sempre più simile a un computer.

Ma perché vogliamo diventare sempre più simili a dei cyborg e avvicinare il nostro cervello al funzionamento di computer? E soprattutto, qual è il prezzo da pagare per tutto ciò? Questo aspetto andrebbe analizzato molto più approfonditamente, ma osservando da vicino gli sviluppi tecnologici si può comunque notare come tutte le innovazioni (del passato recente, del futuro prossimo o in fase di sviluppo) sembrino avere un unico obiettivo: rendere l’essere umano più rapido, più produttivo, in grado di tenere sotto controllo una maggiore mole di dati. In una parola: più efficiente.

Le ricadute lavorative sono evidenti: la nostra costante e immediata reperibilità verrà data ancor più per scontata; così come la capacità di monitorare non-stop e reagire sempre più rapidamente a tutto ciò che compare su schermi che, a quel punto, si troveranno letteralmente appoggiati ai nostri occhi. Questo è il punto: la fusione tra corpo e macchina sembra avere un unico vincitore: il turbocapitalismo. Come scrive Bifo in Futurabilità, “per aumentare il plusvalore relativo, cioè la quantità di plusvalore prodotta nell’unità di tempo, il capitalista introduce nel processo lavorativo innovazioni tecnologiche che aumentano l’intensità dello sfruttamento e, infine, la quantità di plusvalore prodotto”.

In poche parole, l’obiettivo è soprattutto uno: rendere il lavoratore sempre più produttivo, estrarre da lui più lavoro in una data unità di tempo e cercare così di far proseguire la corsa della crescita economica; costi quel che costi, sfruttando la tecnologia per rendere l’essere umano sempre più prevedibile, misurabile, efficiente e razionale. “Se progettassimo un ambiente all’interno del quale gli umani si comportano sempre in maniera perfettamente logica, allora diventeremmo simili alle macchine. E questo dovrebbe preoccuparci”, ha affermato Brett Frischmann, autore di Re-engineering Humanity. Forse dobbiamo iniziare a preoccuparci.

Tecnologia

#2 Deep, fake

19-01-2021

18-01-2021